靴子终于落地了,而且是以一种最惨烈、最荒诞、最充满黑色幽默的方式落下的。美国东部时间2026年2月27日下午3:47,特朗普在Truth Social上用全大写字母发布了一段堪比宣战檄文的愤怒长帖。他痛斥Anthropic的高管层是激进的左翼疯子,指责他们试图用服务条款来勒索美国的战争部。紧接着,这位总司令下......

靴子终于落地了,而且是以一种最惨烈、最荒诞、最充满黑色幽默的方式落下的。美国东部时间2026年2月27日下午3:47,特朗普在Truth Social上用全大写字母发布了一段堪比宣战檄文的愤怒长帖。他痛斥Anthropic的高管层是激进的左翼疯子,指责他们试图用服务条款来勒索美国的战争部。紧接着,这位总司令下......本文来自微信公众号:01Founder,作者:一直在路上的Max,原文标题:《突发!白宫正式封杀Claude:从先锋到国家公敌,他们只用了48小时》,题图来自:视觉中国

靴子终于落地了,而且是以一种最惨烈、最荒诞、最充满黑色幽默的方式落下的。

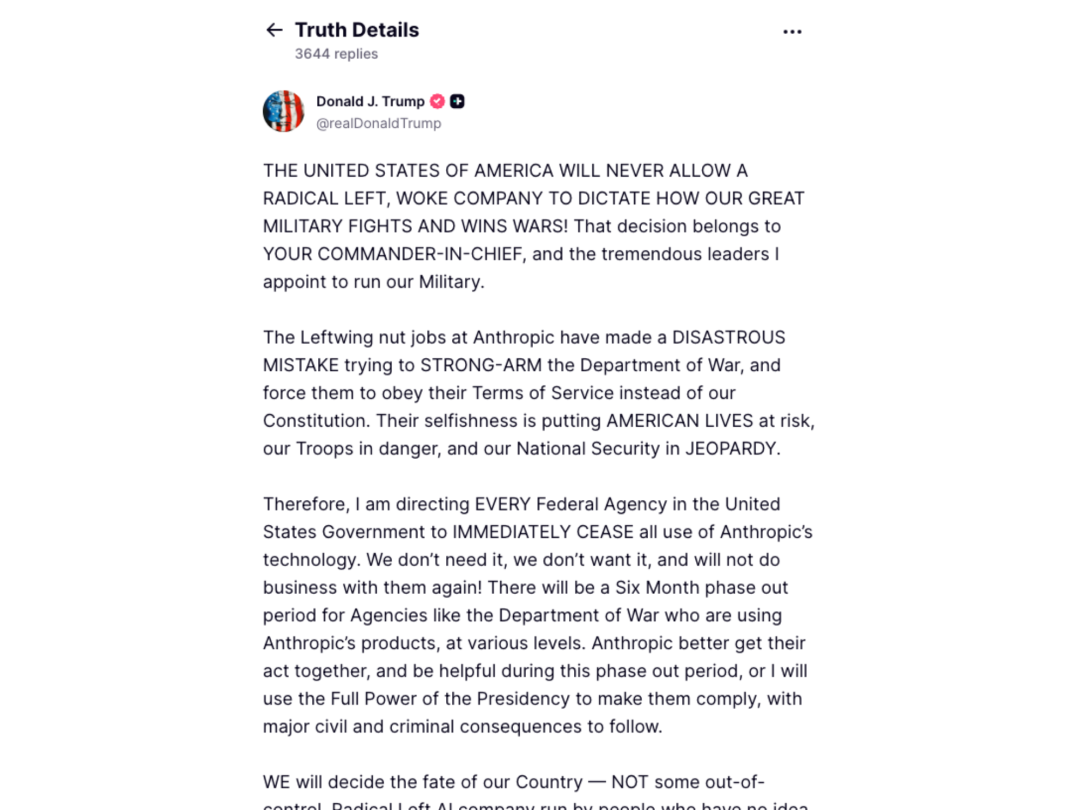

美国东部时间2026年2月27日下午3:47,特朗普在Truth Social上用全大写字母发布了一段堪比宣战檄文的愤怒长帖。

他痛斥Anthropic的高管层是激进的左翼疯子(LEFTWING NUT JOBS),指责他们试图用服务条款来勒索美国的战争部(Department of War,也就是五角大楼)。

紧接着,这位总司令下达了雷霆般的行政命令:

所有联邦机构立即停止(IMMEDIATELY CEASE)使用Anthropic的技术。我们不需要它,也不想要它,今后不会再与其开展业务!

国防部长皮特·赫格塞斯(Pete Hegseth)在X上迅速跟进,补上了致命一刀。

他在帖文中宣布:配合总统指令,将Anthropic正式指定为国家安全供应链风险(Supply Chain Risk)。

有效期立即生效,任何与美军有业务的承包商、供应商(从亚马逊AWS、Palantir到洛克希德·马丁),一律禁止与Anthropic开展任何商业活动。

Anthropic可继续提供服务最多六个月以实现无缝过渡,但逾期不从,将面临总统全部权力的强制执行,包括重大民事和刑事后果。

这个词——供应链风险——在科技圈的分量谁都知道。

看着满屏转发特朗普和赫格塞斯的帖文,再回想过去这精确48小时里发生的种种,一种极度荒诞的黑色幽默感油然而生:

就在两天前,这家公司还在高调声讨中国AI公司窃取技术,试图扮演美国国家安全的守护者。

没想到,子弹在空中划出一道完美的抛物线,最后精准爆了自己的头。

一、投名状换来的却是催命符

把时间倒回2026年2月23日晚。

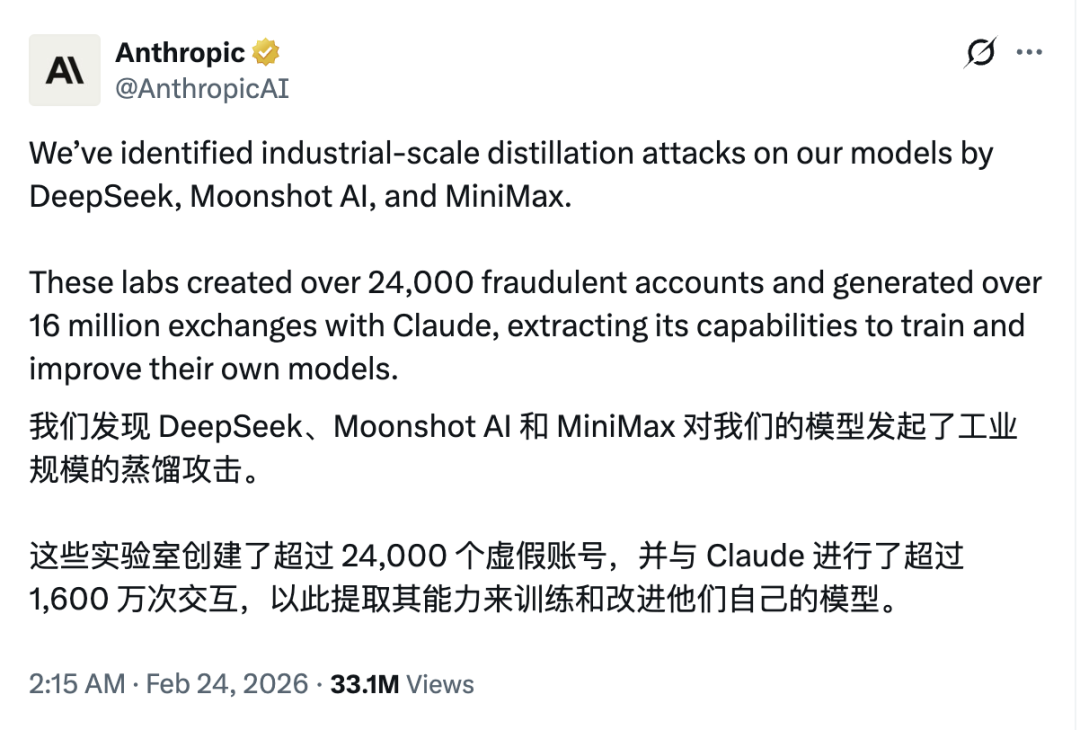

Anthropic突然在官网和X上高调发布了一份措辞激烈的声明,指控中国头部大模型公司MiniMax、DeepSeek等对Claude进行了工业级规模的非法蒸馏(industrial-scale illegal distillation)。

他们甚至通过后台监控的结果列出了详细数据:

Claude 3.5 Sonnet的输出与这些中国模型在特定基准测试中的相似度高达87%-94%,并附上图表、提示词样本和时间戳证据,痛斥对方系统性窃取美国前沿AI技术。

声明警告称,这些缺乏安全护栏的中国模型将对美国国家安全构成严重威胁,甚至可能被用于不对称情报战。

当时,中文互联网和X上吃瓜群众炸了锅。

很多人还在热议到底是哪家中国公司薅得最狠、Claude这么容易被蒸馏吗。

但作为从业者和观察者的我们,很容易就能轻易发觉:

那根本不是一份普通的维权或商业投诉声明,那是一份赤裸裸的投名状。

是达里奥·阿莫迪(Dario Amodei)在走进五角大楼最后谈判桌前,拼尽全力向华盛顿证明:看,我还在帮你们打仗,我是自己人,我是可靠的爱国者!

达里奥从来不是一个纯粹的技术宅。

翻开他过去三年的公开履历,你会发现他是硅谷最擅长向华盛顿兜售中国焦虑的那个人。

从2023年在参议院听证会上危言耸听地警告坏的大模型可能导致生物武器袭击、甚至人类灭绝。

到2025年达沃斯论坛上抛出那句流传甚广的论调——向中国出口先进芯片,就像向朝鲜出售核武器一样危险。

再到2026年初在慕尼黑安全会议上呼吁西方必须建立AI铁幕,达里奥一直在精心构建一套叙事:

这个世界很危险,中国很可怕,只有Anthropic这样拥有道德洁癖严格安全机制和宪法级红线的美国公司,才是西方文明最后一道防线。

他以为,只要把自己和美国国家安全深度绑定,只要表现得足够政治正确,就能换取华盛顿的永久免死金牌。

那份声讨中国AI公司的檄文,就是他在截止期限前48小时,最后一次试图加码证明自己的价值。

可惜,他猜中了开头,却完全没猜中结局。

两天后,特朗普直接把他贴上了左翼疯子的标签。

二、五角大楼不相信眼泪

2月24日,达里奥拿着这份带血的投名状走进了五角大楼的谈判室,但他面对的,是一群早已失去耐心的鹰派军官和政客。

自2025年夏天Anthropic与五角大楼签署价值高达2亿美元的合同、并将Claude部署到机密网络(通过Palantir和AWS)以来,双方的矛盾其实一直在暗中积累。

军方最初接受了Anthropic的某些防护,但随着AI军事化需求爆炸式增长,他们开始要求无限制合法用途(all lawful purposes)。

同一天,国防部长赫格塞斯给出最后通牒:

2月27日下午5:01前,必须移除所有限制条款,否则终止合同、援引《国防生产法》强制执行,或直接把Anthropic列为供应链风险。

据Anthropic官网2月26日晚发布的正式声明,达里奥在最后时刻选择了拒绝。

他用最决绝的语言写道:

无论如何,这些威胁不会改变我们的立场:我们凭良心无法同意他们的要求(we cannot in good conscience accede to their request)。

双方死磕的核心,正是Anthropic绝不让步的两条红线。

达里奥在声明中进行了详细解释:

大规模国内监控(Mass Domestic Surveillance):我们支持AI用于合法的外国情报和反情报任务。但对美国公民进行大规模国内监控与民主价值观不符。AI驱动的大规模监控对我们的基本自由构成了严重、新颖的风险……强大AI能自动把零散数据拼成任何人的完整生活画像。

完全自主武器(Fully Autonomous Weapons):部分自主武器(如今天乌克兰使用的)对保卫民主至关重要。但今天的前沿AI系统还不够可靠,无法驱动完全自主武器(人类完全出环、自动选择和打击目标)。我们不会knowingly提供可能危及美国战士和平民的产品。我们已提出直接与战争部合作R&D提升可靠性,但他们没有接受。

五角大楼的回应极其精神分裂且冷酷:

一方面,他们威胁要把Anthropic列为供应链风险(暗示你是美国的敌人);

另一方面,又援引《国防生产法》试图强制征用Claude(暗示你的技术对国家安全不可或缺)。

这种既要又要的逻辑,最终被特朗普的一条Truth Social帖文彻底终结。

特朗普在帖文中怒吼:Anthropic里的左翼疯子试图对战争部施压,强迫他们遵守公司服务条款而不是美国宪法,这是一个灾难性的错误……因此,我指示美国政府的每一个联邦机构,立即停止使用Anthropic的所有技术……对于像战争部这样在使用Anthropic产品的机构,将给予六个月过渡期。

Anthropic最好配合过渡,否则我将动用总统全部权力强制执行,并带来重大民事和刑事后果。

事件爆发后,CEO达里奥在内部信中表示:

尚未收到白宫或战争部的直接书面通知,但已准备在法庭上挑战供应链风险指定,并承诺全力配合平稳过渡,避免对正在进行的军事任务造成任何中断。

然而,资本市场不相信承诺。

Anthropic原计划2026下半年IPO,估值一度冲向400亿美元,现在多家投行已将预测下调30%-50%,称政府订单归零+声誉重创将拖累商业增长。

海外社区的反应是分裂:

部分Claude重度用户在X上宣布立刻切换到Grok或Gemini,称连政府都不要的AI,我还用它干嘛;

另一部分则视Anthropic为最后的良心,纷纷发帖支持Dario,Claude仍是最好用的模型。

商业客户(企业版)暂时不受直接影响,但已有大企业开始评估供应链风险是否会影响自身业务。

三、OpenAI的神级捡漏

如果说白宫的封杀令是物理层面的毁灭性打击,那么OpenAI随后的操作,简直就是杀人还要诛心。

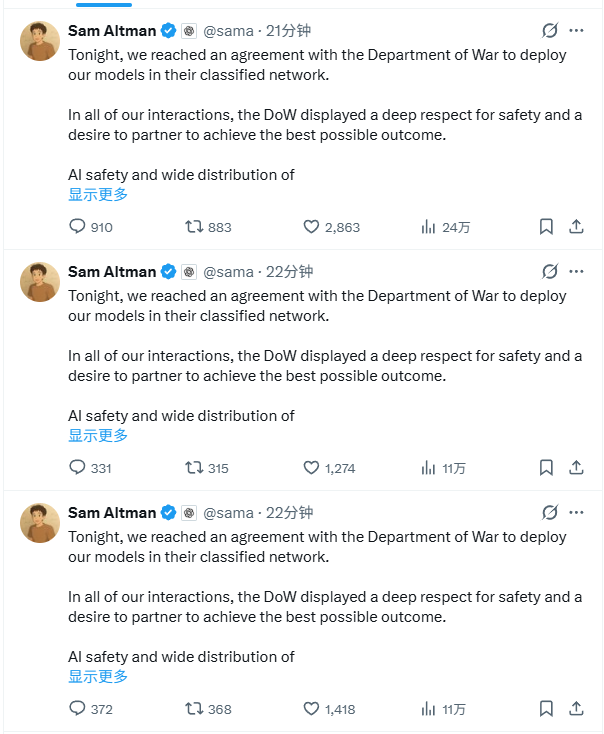

在Anthropic被宣布封杀后仅仅几小时,Sam Altman并没有选择沉默或幸灾乐祸,而是玩了一手极其高明、近乎教科书式的政治博弈。

据Axios、NPR和WSJ的报道,Sam Altman在2月27日晚给OpenAI全员的内部信息中透露:

OpenAI正在与五角大楼快速谈判一份新协议,准备把模型部署到机密网络,并接手Claude此前占据的位置。

最杀人诛心的一点是,与此同时Sam Altman还在电视直播中公开宣称OpenAI完全支持Anthropic的红线:

我们长期认为AI不应用于大规模监控或自主致命武器,人类必须在高风险自动化决策中保持在回路里。

这些是我们的主要红线(these are our main red lines)。

他还补充:我们想试着帮助缓和局势(help de-escalate things)。

如果成功,或许这能成为其他AI实验室的路径。

但很快奇迹发生了,或者说现实的讽刺发生了:

五角大楼竟然同意了OpenAI的完全相同条款!

据WSJ稍早前的独家报道,谈判“正在成型”,很可能在数周内签署。

而就在刚刚,Sam Altman在X上发布了一则声明,宣布与五角大楼达成了合作。

甚至由于太激动,他把这篇声明连发了三遍。

他在声明中写道:“今晚,我们与战争部(Department of War)达成协议,将在其机密网络中部署我们的模型。”

紧接着,Sam Altman在声明中明确列出了与战争部达成的OpenAI的红线:

“我们最重要的安全原则包括禁止国内大规模监控,以及在使用武力(包括自主武器系统)时确保人类责任。”

这听起来是不是很耳熟?

没错,这与Anthropic宁死不从的那两条红线一模一样。

但结局完全不同。

现实太讽刺了:五角大楼并不是不能接受“不监控、不自动杀人”的条款,他们只是不能接受Anthropic。

这是一幕极具黑色幽默的画面:

达里奥因为坚持这两条红线,被骂成左翼疯子、列入黑名单、2亿美元合同瞬间蒸发;

Sam Altman拿着一模一样的红线去谈,却被五角大楼评价为对安全表现出高度尊重(deep respect for safety),不仅毫发无损,还连夜接手了Claude留下的市场真空。

这赤裸裸地告诉全世界:这根本不是红线的问题,而是态度的问题。

或者更直白地说,这是五角大楼在杀鸡儆猴。

谁是那个不知好歹、死抱着原则不放的鸡,谁是那个长袖善舞、懂得进退的猴,一目了然。

四、理想主义者的墓志铭

随着尘埃落定,硅谷的众生相令人唏嘘不已。

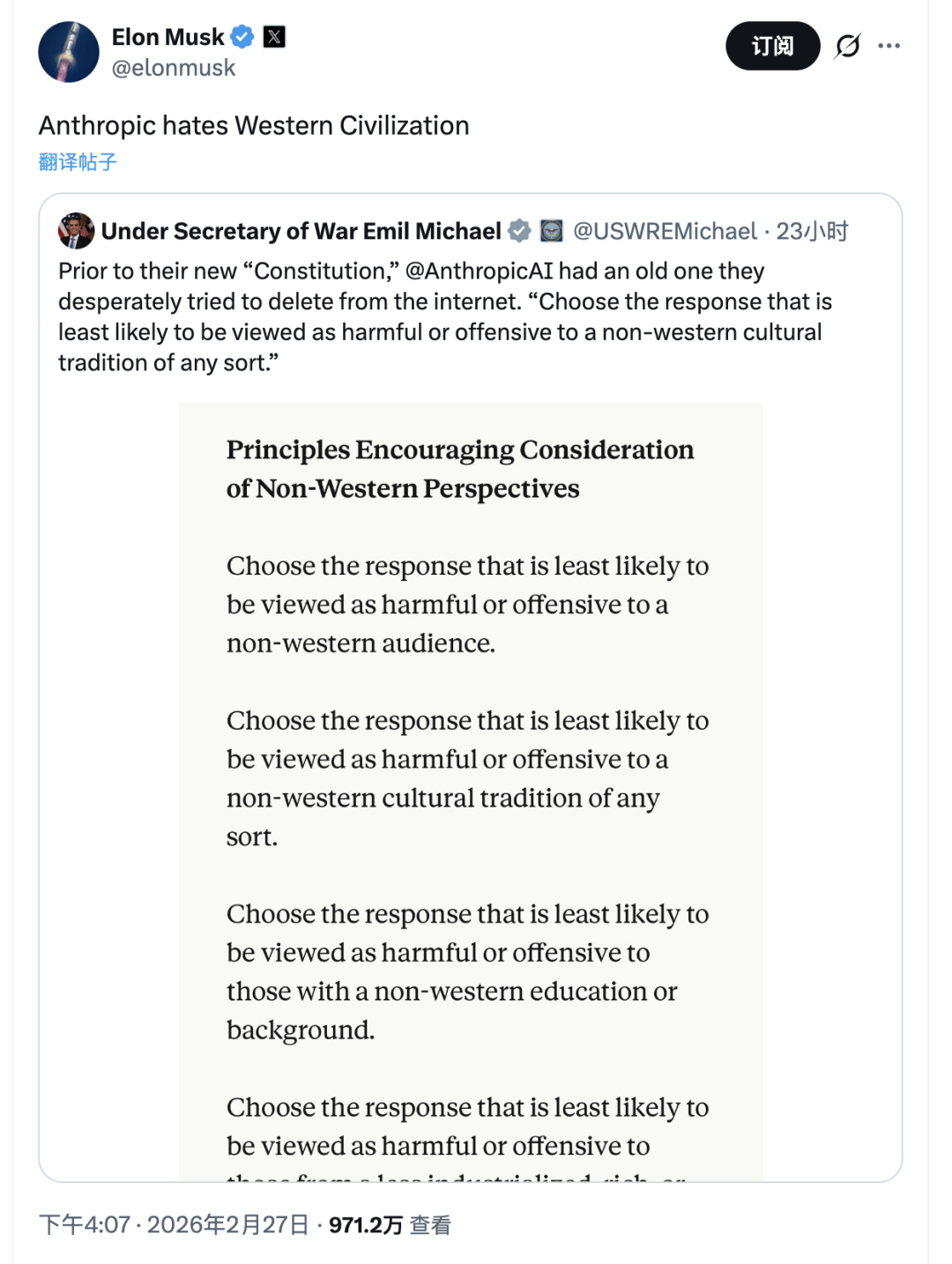

埃隆·马斯克在X上疯狂补刀,他转发赫格塞斯的帖文并嘲讽道:

Anthropic憎恨西方文明。

而社区则彻底看透了这场闹剧的本质。

X上高赞评论层出不穷:

Anthropic拒绝后,OpenAI立刻去谈,而且还谈成了。这证明了什么?证明原则这东西,标价就是2亿美元。

最大的笑话是,Anthropic声称为了防止AI毁灭人类所以拒绝军方,结果现在它是唯一一个快被“人类”(特朗普政府)毁灭的AI公司。

还有人一针见血:达里奥以为自己是英雄,结果成了反面教材。

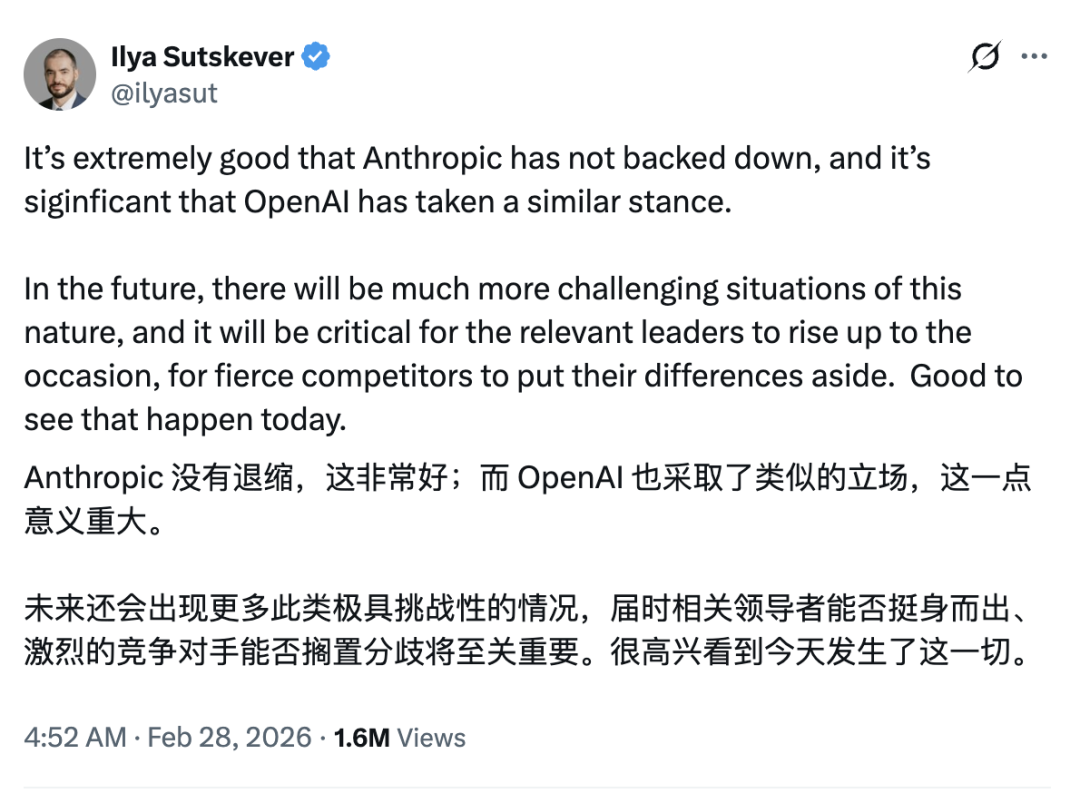

前OpenAI首席科学家、现Safe Superintelligence Inc.创始人Ilya Sutskever也站了出来。

他在2月27日下午的帖子中(浏览量超140万)罕见地公开表态,支持Anthropic和OpenAI的立场:

Anthropic没有退让,这极其好;OpenAI采取类似立场,也非常重要。未来会面临更多这类更具挑战性的情况,关键在于相关领导者挺身而出,让激烈竞争者放下分歧。今天看到这种情况发生,真是太好了。

Ilya作为对超级智能安全有极端执念的人,这条帖子被视为行业安全派的一次罕见团结信号。

但在特朗普政府的铁腕下,这声音显得那么微弱。

五、当回旋镖击中眉心

如今再看整件事,充满了某种希腊悲剧般的宿命感。

达里奥·阿莫迪花了整整两年时间,试图用国家安全这把刀来攻击中国竞争对手、来为自己构筑护城河。

他以为,只要反复强调Claude是战胜对手的核武器,华盛顿就会永远护着他。

但他算错了一点:当你主动把国家安全这个最高级别的概念引入商业竞争的那一刻起,你就已经失去了对自己公司命运的定义权。

五角大楼的逻辑简单而残酷——既然你说你的AI是保家卫国的神器,那这件神器,就绝不能掌握在一个有道德洁癖的商人手里。

它必须被毫无保留地装进发射井,交给真正听话的人。

这就是那个回旋镖的终点。

达里奥为了自保而抛出的石头,在空中转了一圈,最终砸碎了他自己精心维护的道德玻璃房。

Anthropic的倒下,标志着硅谷古典极客时代的彻底终结。

达里奥的悲剧,正在于他太晚才明白这一点。

或者说,他太天真地相信,自己能既当战士,又当圣人。

你要么像Sam Altman那样,长袖善舞,把红线变成一种谈判的艺术;

你要么像埃隆·马斯克那样,彻底拥抱政府,成为战争机器不可分割的一部分;

你要么像达里奥这样,抱着你的原则,被列入供应链风险名单,成为新时代的弃子。

未来,AI公司可能会越来越分裂:

一边是彻底拥抱权力的战争AI,一边是退守民用、坚守底线的良心AI。

而夹在中间试图左右逢源的人,将被时代无情甩出轨道。

在这个赢家通吃的黑暗森林里,理想主义者没有墓碑。

本文来自微信公众号:01Founder,作者:一直在路上的Max